انسانها توانایی فوق العادهای در انتقال دانش دارند. زمانی که با مشکل یا چالش جدیدی روبرو میشویم، از تجربیات گذشته خود بهره میبریم تا آن را حل کنیم. وقتی دوچرخهسواری را بلد باشیم، یاد گرفتن موتورسواری آسانتر خواهد بود؛ چرا که پیشتر حفظ تعادل و راندن یک وسیله نقلیه دوچرخ را یاد گرفتهایم. ایده یادگیری انتقالی (Transfer Learning) هم براساس همین مثال و با الهام از رویکرد یادگیری انسانی متولد شد.

یادگیری انتقالی تکنیکی است که در آن دانش بهدستآمده از آموزش یک مدل در کار یا حوزه، برای بهبود عملکرد مدل در یک کار یا حوزه متفاوت استفاده میشود. اما چرا یادگیری انتقالی مهم است؟ چگونه کار میکند و چه فناوریهای پشت آن قرار دارد؟ در این مطلب از بلاگ آسا به موضوعات پیرامون یادگیری انتقالی در یادگیری ماشینی میپردازیم. با ما همراه باشید.

یادگیری انتقالی چیست؟

یادگیری انتقالی یک رویکرد یادگیری ماشین است که در آن از دانش و دادههای یک مدل، برای توسعه یا بهبود یک مدل متفاوت استفاده میشود. یادگیری انتقالی به شما این امکان را میدهد که از آموزشهای قبلی برای حل مشکلات جدید و مرتبط استفاده کنید و در نتیجه زمان و منابع محاسباتی را کاهش دهید. بهعنوان مثال، اگر مدلی را برای تشخیص ساعت مچی در تصاویر آموزش دهیم، میتوانیم از آن برای شناسایی اشیایی مانند ساعت دیواری یا ساعت رومیزی استفاده کنیم.

بنابراین به جای اینکه از ابتدا شروع کنیم، با الگوها و اطلاعاتی که مدل از یک کار مشابه آموخته است، شروع میکنیم. یادگیری انتقالی معمولا در کارهایی مانند تجزیه و تحلیل تصاویر یا درک زبان استفاده میشود، اما قبل از اینکه به تمام کاربردهای آن بپردازیم، بیایید نحوه کار آن را بررسی کنیم.

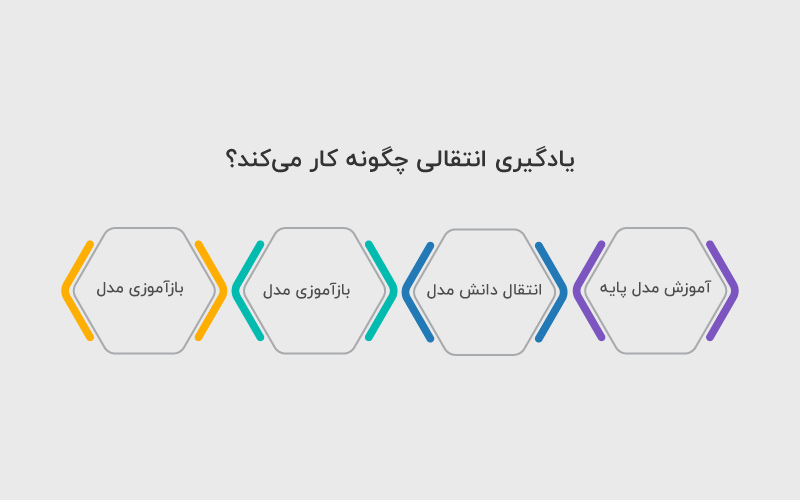

یادگیری انتقالی چگونه کار میکند؟

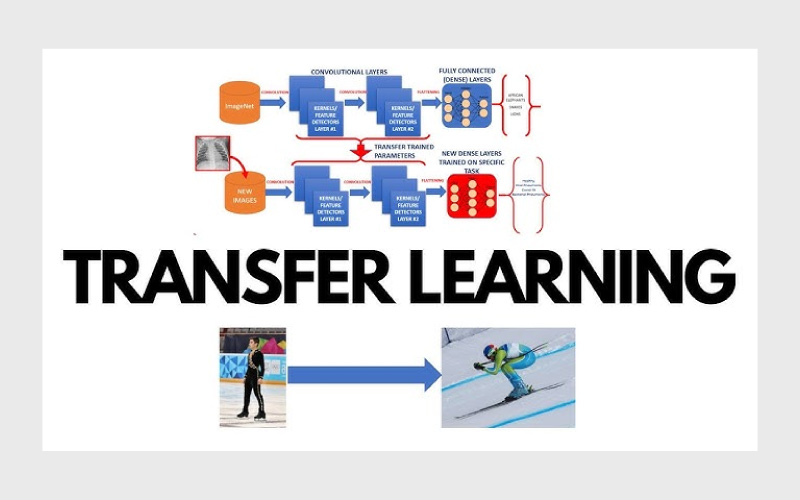

ایده اساسی پشت یادگیری انتقالی حول استفاده از یک شبکه یادگیری عمیق است که قبلا برای حل یک مشکل یا کاربرد کلیتر آموزش دیده است. توسعهدهندگان باید این مدل را با توجه به اهداف خود برای یک کاربرد و هدف خاصتر تغییر دهند. در ادامه نحوه کار این تکنیک را به زبان ساده توضیح میدهیم:

آموزش مدل پایه (Pre-training)

ابتدا، یک مدل یادگیری ماشین روی یک مجموعه بزرگ و جامع از داده آموزش میبیند. این مدل معمولا روی دیتاستهایی مانند ImageNet (برای تصاویر) یا مجموعههای بزرگ متنی مانند Wikipedia (برای پردازش زبان طبیعی) آموزش میبیند. هدف چنین مدلهایی این است که ویژگیهای عمومی و پایهای را برای توسعه مدلهای خاصتر فراهم کنند. برای مثال، یک شبکه عصبی کانولوشنی (CNN) که روی میلیونها تصویر آموزش دیده است، میتواند الگوهای بصری پایهای مانند خطوط، لبهها و اشکال را یاد بگیرد.

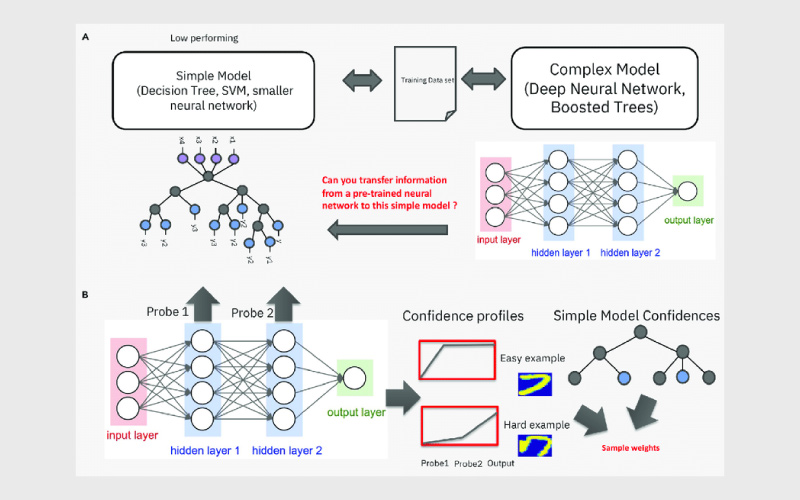

انتقال دانش مدل (Knowledge Transfer)

این مرحله، شروع واقعی فرایند یادگیری است که در آن انتقال دانش از مدل پایه به مدل جدید انجام میشود. بنابراین توسعهدهندگان، ویژگیها و دادههایی را که برای حل مشکل یا هدف جدید خود نیاز دارند، از مدل پایه استخراج میکنند. برای مثال، اگر مدل بتواند اشیا و الگوهای عمومی در تصاویر را تشخیص دهد، این دانش میتواند به تشخیص اشیا خاصتر در یک مجموعه داده جدید کمک کند.

بازآموزی مدل (Fine-tuning)

در ادامه به جای اینکه کل مدل را از ابتدا آموزش دهیم، تنها برخی از لایههای بالاتر (یا نهایی) مدل را بازآموزی (تنظیم) میکنیم. این بخشها برای ویژگیهای خاصتر آموزش داده میشوند. هدف این است که دانشهای بهدستآمده از مدل پایه حفظ شود و در عین حال، پارامترهای مورد نیاز برای مدل جدید و خواستههای فعلی تغییر کند. در این مرحله توسعهدهندگان از رویکردهای مختلفی استفاده میکنند که ممکن است یک بخش یا تمام مدل مجددا آموزش داده شود. در مورد این رویکردها در بخش بعدی بیشتر صحبت میکنیم.

استفاده از مدل در مسئله جدید

پس از بازآموزی، مدل در مسئله جدید به کار گرفته میشود. بنابراین مدلی خواهیم داشت که توسعه آن از صفر شروع نشده و به لطف مدل پایه میتواند ویژگیهای موردنیاز برای مسئله جدید را سریعتر و دقیقتر تشخیص دهد.

همانطور که میبینید، کلیدیترین بخش در یادگیری انتقالی، انتقال دانش از مدل پایه و بازآموزی مدل جدید با رویکردهای مشخص است. در ادامه این رویکردها را بررسی میکنیم.

رویکردهای مورد استفاده در یادگیری انتقالی

یادگیری انتقالی رویکردهای مختلفی را برای استفاده از دانش از مدلهای از پیش آموزش دیده و اعمال آن در وظایف جدید ارائه میدهد. در ادامه معروفترین این رویکردها را مرور میکنیم.

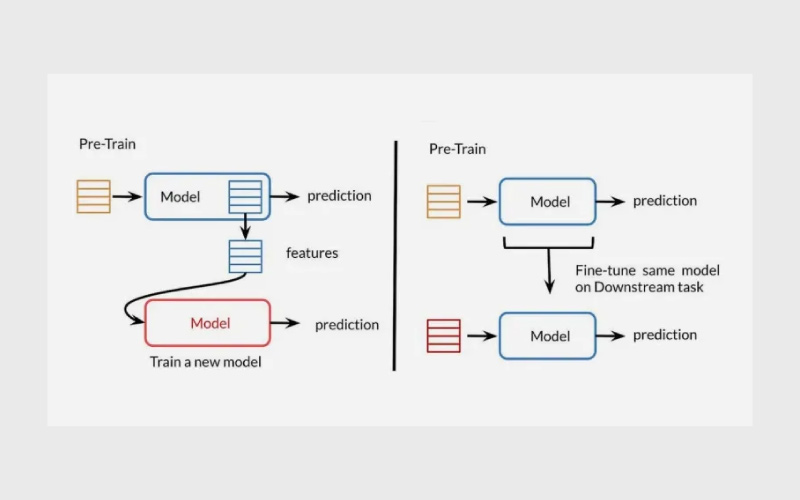

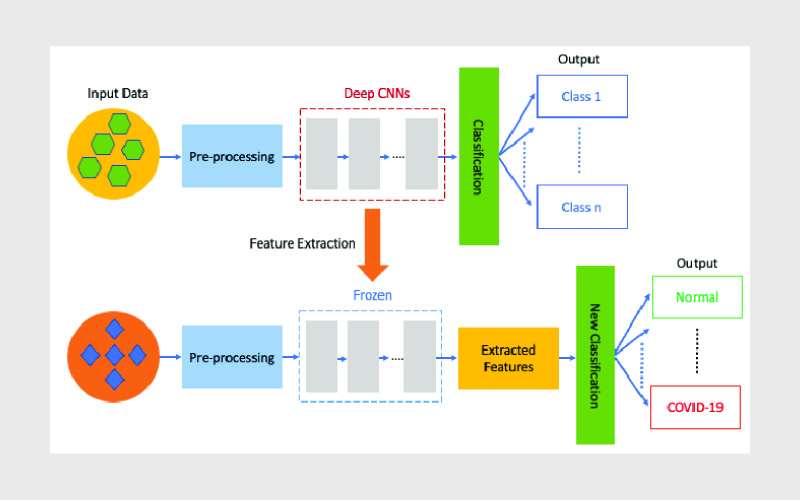

استخراج ویژگی (Feature Extraction)

در این رویکرد، مدل از پیشآموزشدیده بهعنوان یک استخراجکننده ویژگی عمل میکند. به عبارت ساده، لایههای اولیه در یک مدل پایه شامل اطلاعات اولیه هستند که میتوانند برای طیف وسیعی از مسائل استفاده شوند. بنابراین این لایهها بدون تغییر در مدل جدید هم استفاده میشوند و فقط لایههای انتهایی دوباره آموزش میبینند تا با اهداف جدید سازگار باشند.

تنظیم دقیق (Fine-tuning)

تنظیم دقیق شامل بهروزرسانی وزنها و پارامترهای یک مدل پایه با استفاده از مجموعه دادههای لازم برای وظایف جدید است. همانند رویکرد قبلی، اینجا هم لایههای بالایی مدل (که اطلاعات خاصتری دارند) آموزش داده میشوند تا مدل به مسئله جدید دقیقتر پاسخ دهد. تنظیم دقیق با ایجاد تغییرات ظریف و حفظ دانش عمومی بهدستآمده از مدل پایه، به مدل جدید این امکان را میدهد تا برای وظایف خاص کارآمد باشد. این رویکرد زمانی مفید است که دادههای مسئله جدید به مسئله اولیه نزدیک باشد.

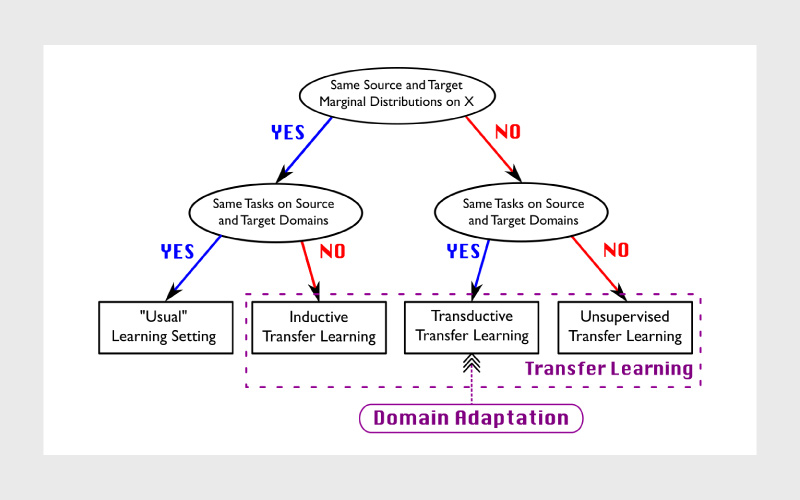

تطبیق دامنه (Domain Adaptation)

این رویکرد زمانی به کار میرود که دامنه دادههای جدید با دامنه دادههای اصلی تفاوتهای قابلتوجهی دارد. در این حالت، مدل با انجام تغییراتی برای هماهنگی بهتر با دامنه جدید (مانند تغییر در ساختار دادهها یا توزیع ویژگیها) بهینهسازی میشود تا بتواند در شرایط جدید هم عملکرد خوبی داشته باشد.

یادگیری چندوظیفهای (Multi-task Learning)

در این رویکرد، مدل بهطور همزمان برای چندین وظیفه آموزش داده میشود. هدف این است که مدل با یادگیری وظایف مختلف، بتواند ویژگیهای مشترک بین آنها را بهتر درک کند و دانش خود را برای مسائل مختلف به کار ببرد. این روش زمانی کاربرد دارد که وظایف مختلف دارای اشتراکات زیادی باشند و یادگیری یکی به بهبود دیگری کمک کند.

این رویکردها هر کدام در شرایط مختلف یادگیری انتقالی قابل استفاده هستند و بسته به نوع دادهها و مسئله مورد نظر، رویکرد مناسب انتخاب میشود.

کاربردهای یادگیری انتقالی

یادگیری انتقالی به توسعهدهندگان کمک میکند تا از مدلهای از قبل آموزش داده شده برای اهداف مختلف، از پردازش تصویر، طبقهبندی و تشخیص اشیا تا ترجمه متون و حتی آموزش خودروهای خودران استفاده کنند. در ادامه بیشتر به کاربردهای یادگیری انتقالی خواهیم پرداخت.

بینایی کامپیوتر

بینایی کامپیوتر رشتهای است که به توانمندسازی ماشینها برای درک و تفسیر دادههای بصری مانند تصاویر و فیلمها میپردازد. بینایی کامپیوتر به مجموعه دادههای بزرگی از تصاویر مختلف نیاز دارد تا بتواند از آنها برای تشخیص و طبقهبندی اشیاء درون تصاویر استفاده کند. در این زمینه، یادگیری انتقالی امکان استفاده از مدلهای آموزش دیده بر روی مجموعه دادههای بزرگ و اعمال آنها در مجموعههای تصویر کوچکتر را فراهم میکند.

بهعنوان مثال، مدلهای معروفی مانند ResNet، VGG و EfficientNet که روی دیتاستهای عظیم مثل ImageNet آموزش دیدهاند، میتوانند با تغییرات کوچکی برای طبقهبندی تصاویر در حوزههای خاصتر مانند تصاویر پزشکی یا تشخیص کالاها در فروشگاهها استفاده شوند.

پردازش زبان طبیعی

پردازش زبان طبیعی (NLP)، شاخهای از هوش مصنوعی است که بر تعامل بین رایانه و انسان از طریق زبان طبیعی تمرکز دارد. هدف NLP کمک به رایانهها برای پردازش و تجزیه و تحلیل مقادیر زیادی از دادههای زبان طبیعی است. یادگیری انتقالی نقش مهمی در توسعه مدلهای NLP ایفا میکند. به عنوان مثال، مدلهایی مانند BERT و GPT ابتدا روی مقادیر زیادی از دادههای متنی آموزش دیده و سپس برای وظایف خاصتری مانند ترجمه یا خلاصهسازی استفاده میشوند. NLP بیشمار کاربرد در زمینه های مختلف دارد که شامل دستیارهای صوتی و تشخیص گفتار و …. میشوند.

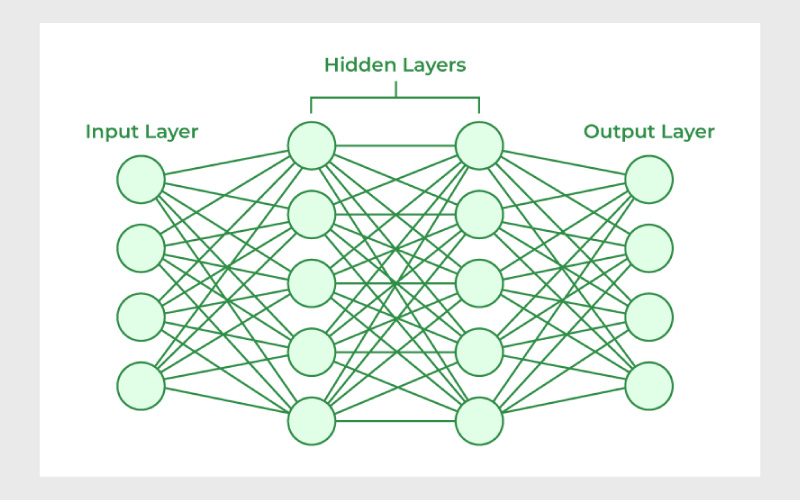

شبکههای عصبی

شبکههای عصبی بخشی جدانشدنی از یادگیری عمیق هستند که عملکردهای مغز انسان را تقلید میکنند. با این حال، آموزش این شبکهها به دلیل پیچیدگی مدلها میتواند از نظر محاسباتی سخت باشد. یادگیری انتقالی راه حلی برای کاهش این نیاز به منابع و بهبود کارایی در فرایند آموزش ارائه میدهد. یادگیری انتقالی امکان انتقال ویژگیهای ارزشمند آموخته شده از یک شبکه به شبکه دیگر را فراهم میکند تا روند توسعه تسریع شود. با به کارگیری دانش بهدستآمده از یک مدل عصبی، امکان استفاده کارآمد از آن برای وظایف مختلف ممکن خواهد شد و قابلیت یادگیری و عملکرد کلی مدلها را افزایش میدهد.

علاوهبر موارد بالا، یادگیری انتقالی در حوزههای کمداده مسائل پزشکی که دادههای کافی برای آموزش مدلها وجود ندارد، استفاده میشود.

چرا از یادگیری انتقالی استفاده کنیم؟

استفاده از یادگیری انتقالی در یادگیری عمیق مزایای مختلفی را به همراه دارد و آن را به یک رویکرد جذاب تبدیل میکند. مزایای اولیه شامل صرفهجویی در زمان آموزش، بهبود عملکرد شبکه عصبی و کاهش نیاز به حجم گسترده داده است.

کاهش حجم داده جدید

آموزش یک شبکه عصبی، اغلب به مقدار قابل توجهی داده نیاز دارد. با این حال، در بسیاری از سناریوها، دسترسی به چنین دادههایی محدود است یا بهراحتی ممکن نیست، اینجاست که یادگیری انتقالی میتواند کمک کننده باشد. به جای اینکه یک مدل از پایه برای یک کار جدید آموزش داده شود، یادگیری انتقال به ما این امکان را میدهد که از مدلهای از پیش آموزش دیدهای استفاده کنیم که قبلا با مقادیر زیادی داده آموزش دیدهاند. این روش، به ویژه در پردازش زبان طبیعی کارآمد است، جایی که ساخت مجموعه دادههای بزرگ برچسبگذاریشده به دانش تخصصی و منابع قابل توجهی نیاز دارد.

کاهش زمان آموزش

علاوهبر این، یادگیری انتقالی زمان آموزش را به میزان قابل توجهی کاهش میدهد. از پایه آموزش دادن یک شبکه عصبی عمیق میتواند زمانبر باشد و گاهی روزها یا هفتهها طول بکشد. با این حال، زمان آموزش اولیه را میتوان با استفاده از یادگیری انتقال به حداقل رساند؛ زیرا مدل از پیش آموزشدادهشده، ویژگیها و الگوهای مهمی در خود دارد که باعث صرفهجویی در زمان و منابع محاسباتی ارزشمند میشود. بنابراین، یادگیری انتقال چالشهای در دسترس بودن دادههای محدود و زمانهای طولانی آموزش را برطرف میکند و امکان ایجاد مدلهای یادگیری ماشینی موثر با مجموعه دادههای کوچکتر و کاهش زمان مورد نیاز برای آموزش مدل را فراهم میکند.

جمعبندی

یادگیری انتقالی با بهرهگیری از دانش و مدلهای موجود، قابلیتهای یادگیری ماشین را بهبود بخشیده و پردازش مدل را سریعتر و کارآمدتر میکند. این امر ساخت مدلهای جدید و کاربردی را کمهزینهتر و سریعتر خواهد کرد. در نتیجه، کسبوکارهای مختلف میتوانند از مزایای یادگیری ماشینی بهره ببرند. باید منتظر ماند و دید که کسبوکارها چگونه از یادگیری انتقالی (Transfer Learning) برای رقابت در بازار استقبال میکنند.

منابع:

www.ibm.com | www.techtarget.com

سوالات متداول

در پردازش تصویر، پردازش زبان طبیعی، تحلیل صوت و حتی پیشبینیهای مالی کاربرد دارد.

کتابخانههایی مانند TensorFlow، PyTorch، Keras و Hugging Face ابزارهای مختلفی برای استفاده از یادگیری انتقالی ارائه میدهند.

در یادگیری انتقالی، از مدلهای از پیش آموزشدیده استفاده میشود و نیاز به داده و زمان آموزش کمتر است، در حالی که آموزش از ابتدا نیازمند مجموعه داده بزرگ و زمان پردازشی بیشتر است.

دیدگاهتان را بنویسید